Published November 21, 2024

Unternehmens-LLM neu denken: Sichere, kostengünstige KI

7 min read

Samir Yacini

Growth Marketer

Have questions or want a demo?

We're here to help! Click the button below and we'll be in touch.

Get a Demo

AI Summary by QAnswer

KI im Unternehmen neu denken: Sicheres und kosteneffizientes LLM

Da KI zunehmend zum Mittelpunkt der unternehmerischen Innovation wird, ist die Entscheidung zwischen cloudbasierten und on-premise Large Language Models (LLMs) wichtiger denn je. Wenn Sie nach Wegen suchen, Unternehmens-LLMs zu nutzen, ohne die Datensicherheit oder Kostenkontrolle zu beeinträchtigen, sind Sie hier genau richtig.

In diesem Leitfaden erläutere ich, wie die lokale Bereitstellung von LLMs klare Vorteile bietet – von erhöhter Datenvertraulichkeit bis hin zu kostengünstigen KI-Lösungen. Am Ende werden Sie verstehen, warum immer mehr Organisationen ihre KI-Systeme in-house verlagern und wie auch Sie Ihr Unternehmens-LLM-Deployment sicher und effizient gestalten können. Legen wir los!

Einführung in Unternehmens-LLMs: Trends und Herausforderungen

In den letzten Jahren haben Large Language Models (LLMs) für Unternehmen erheblich an Bedeutung gewonnen und revolutionieren die Art und Weise, wie Organisationen mit Daten interagieren und diese interpretieren. Typischerweise setzen Unternehmen auf cloudbasierte LLMs, die Skalierbarkeit und sofortige Zugänglichkeit bieten. Da jedoch die Datenschutzbedenken zunehmen, erwägen immer mehr Organisationen lokale Sprachmodelle, um ihre Daten näher am eigenen Standort zu halten. Diese Entwicklung hin zu on-premise LLM-Deployments spiegelt eine wachsende Nachfrage nach Datenschutz, Kontrolle und Compliance wider, insbesondere in regulierten Branchen wie dem Gesundheitswesen, der Finanzbranche und dem Rechtswesen.

Lassen Sie uns untersuchen, wie ein Umdenken bei cloudbasierten LLM-Strategien hin zur lokalen Bereitstellung diese aufkommenden Herausforderungen bewältigen kann.

Warum lokale Sprachmodelle immer beliebter werden

Die Attraktivität lokaler Sprachmodelle liegt in ihrer Fähigkeit, die wichtigsten Unternehmensanforderungen an Datenvertraulichkeit und -kontrolle zu erfüllen. Im Gegensatz zu cloud-gehosteten LLMs, die eine Übertragung von Daten außerhalb des Unternehmens erfordern, ermöglichen on-premise Modelle es Organisationen, KI-Lösungen direkt in ihrer eigenen Infrastruktur zu betreiben. Diese Fähigkeit ist für Branchen, die mit sensiblen oder proprietären Informationen umgehen, unerlässlich.

On-premise LLM-Deployments ermöglichen es Unternehmen, strenge regulatorische Standards einzuhalten, da Daten vor Ort verarbeitet und gespeichert werden und so die Exposition gegenüber externen Netzwerken begrenzt wird. Indem sie der Vertraulichkeit von Unternehmensdaten Priorität einräumen, können Organisationen von KI profitieren, ohne die Privatsphäre zu gefährden.

RAG in Unternehmens-LLMs: Genauigkeit und Effizienz verbessern

Ein wesentlicher Vorteil der on-premise LLM-Bereitstellung ist das Potenzial zur Integration von Retrieval-Augmented Generation (RAG)-Techniken, die die Fähigkeit der KI verbessern, präzise und kontextuell relevante Antworten zu liefern. RAG kombiniert Sprachmodelle mit einem Retrievalsystem, wodurch Unternehmen Daten aus spezifischen, zuverlässigen Quellen in Echtzeit abrufen können. Diese Methode ist besonders nützlich in datensensiblen Branchen, wo LLMs Antworten auf Basis aktueller, sicher lokal gespeicherter Informationen generieren können.

Mit RAG können Organisationen, die die on-premise LLM-Lösungen von QAnswer nutzen, die Antwortgenauigkeit verbessern und gleichzeitig sicherstellen, dass Daten vertraulich bleiben und internen Standards entsprechen. Diese Verbindung von Retrieval und Generierung stärkt die Attraktivität lokaler Sprachmodelle für Unternehmen, die sowohl verbesserte Leistung als auch robuste Datensicherheit anstreben.

Der Sicherheitsvorteil von on-premise LLMs

Einer der wichtigsten Vorteile von on-premise LLM-Deployments ist das erhöhte Sicherheitsniveau, das sie bieten. Cloudbasierte LLMs können anfällig für Datenverletzungen sein, da sensible Informationen zu und von Drittanbieterservern übertragen werden müssen. Mit on-premise LLMs behalten Organisationen die exklusive Kontrolle über ihre Daten. Dies ist besonders wertvoll in Branchen, in denen Datenschutz und Vertraulichkeit von Unternehmensdaten nicht verhandelbar sind.

Bei The QA Company unterstützt unsere QAnswer-Plattform sichere Konfigurationen, die alle Dateninteraktionen innerhalb der eigenen Firewall einer Organisation halten, Risiken im Zusammenhang mit Drittanbieter-Zugriffen minimieren und die Einhaltung interner Datenschutzrichtlinien ermöglichen.

Leistung von on-premise LLMs vs. cloudbasierte Lösungen

Entgegen der Annahme, dass cloudbasierte Modelle von Natur aus überlegen sind, können on-premise LLMs Leistungsniveaus bieten, die mit ihren cloud-basierten Pendants vergleichbar oder sogar überlegen sind. Durch den Betrieb von Modellen in eigenen Netzwerken können Unternehmen die Leistung lokaler Sprachmodelle gemäß ihrer Infrastrukturspezifikationen optimieren.

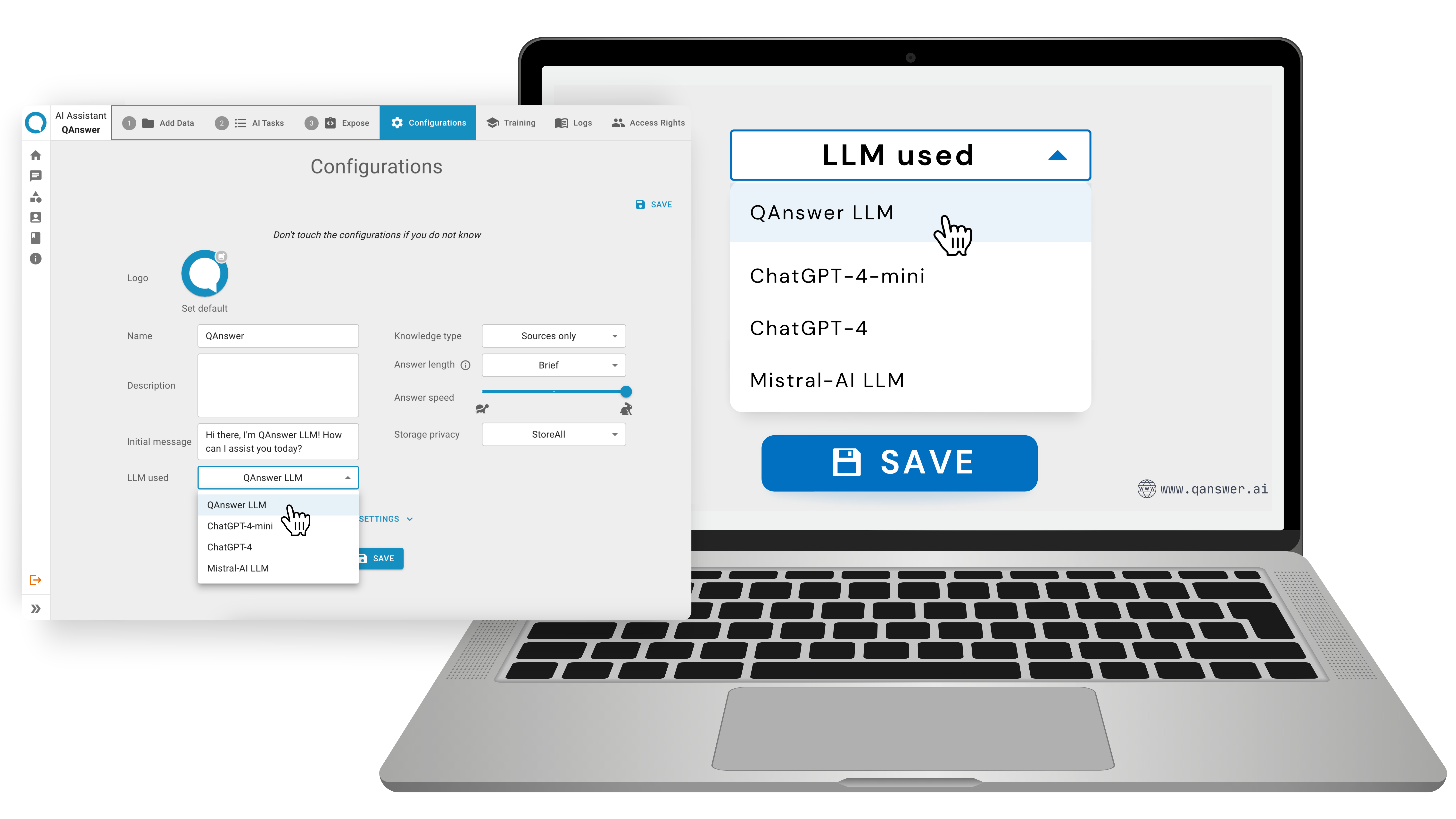

Mit QAnswer erhalten Unternehmen Zugang zu einer Reihe von LLMs, die sie innerhalb derselben Plattform konfigurieren und testen können. Diese Flexibilität erleichtert den Vergleich des QAnswer LLM mit populären cloudbasierten LLMs wie OpenAI LLM und Mistral LLM. Solche Vergleiche befähigen Unternehmen, die Leistung auf ihre individuellen Bedürfnisse abzustimmen.

Kostenmanagementvorteile bei lokalen LLM-Deployments

Der Wechsel zu on-premise LLM-Deployments geht nicht nur um Sicherheit und Datenkontrolle – es ist auch eine kosteneffiziente Wahl. Cloud-LLMs sind oft mit wiederkehrenden Abonnementgebühren verbunden, die sich im Laufe der Zeit erheblich summieren können, insbesondere bei großem Datenbedarf. Mit lokalen Sprachmodellen können Unternehmen diese laufenden Kosten vermeiden. Durch eine einmalige Infrastrukturinvestition erhalten Organisationen Budgetprävisibilität und langfristige Kosteneinsparungen.

Die on-premise LLM-Optionen von QAnswer ermöglichen es Unternehmen, Budgetstabilität zu wahren und dabei hochwertige KI-Leistung ohne zusätzliche Cloud-Gebühren zu erzielen.

QAnswers vielseitige LLM-Bereitstellungsoptionen

Die QAnswer-Plattform bietet einzigartige Flexibilität bei Unternehmens-LLM-Deployments. Sie unterstützt mehrere LLMs und ermöglicht es Unternehmen, einfach zwischen verschiedenen Modellen zu wechseln, ob Open-Source oder kommerziell verfügbar. So können Unternehmen beispielsweise das QAnswer LLM neben beliebten Modellen wie OpenAI LLM oder Mistral testen, ohne die Plattform verlassen zu müssen.

Diese Vielseitigkeit ermöglicht es Organisationen, Large Language Models zu experimentieren, zu optimieren und an spezifische Geschäftsanforderungen anzupassen. Durch die Bereitstellung einer einzigen Plattform für das LLM-Management macht QAnswer die Modellexperimentierung zugänglich und einfach.

Branchen, die von lokalen LLM-Deployments profitieren

Bestimmte Branchen wie das Gesundheitswesen, die Finanzbranche, der öffentliche Sektor und das Rechtswesen haben strenge Anforderungen an Datensicherheit und Vertraulichkeit von Unternehmensdaten. Diese Sektoren profitieren erheblich von lokalen LLM-Deployments, bei denen sensible Daten die Infrastruktur der Organisation nie verlassen.

Im Gesundheitswesen beispielsweise können Patientendaten innerhalb der Einrichtung sicher bleiben und gleichzeitig von KI-gestützter Diagnostik und Informationsabfrage profitieren. Ähnlich können Finanzunternehmen sicherstellen, dass Kundendaten privat bleiben, während sie LLMs für die Risikobeurteilung oder Betrugserkennung nutzen. Anwaltskanzleien können on-premise LLMs einsetzen, um große Mengen von Rechtsfällen zu analysieren, ohne die Mandantenvertraulichkeit zu gefährden.

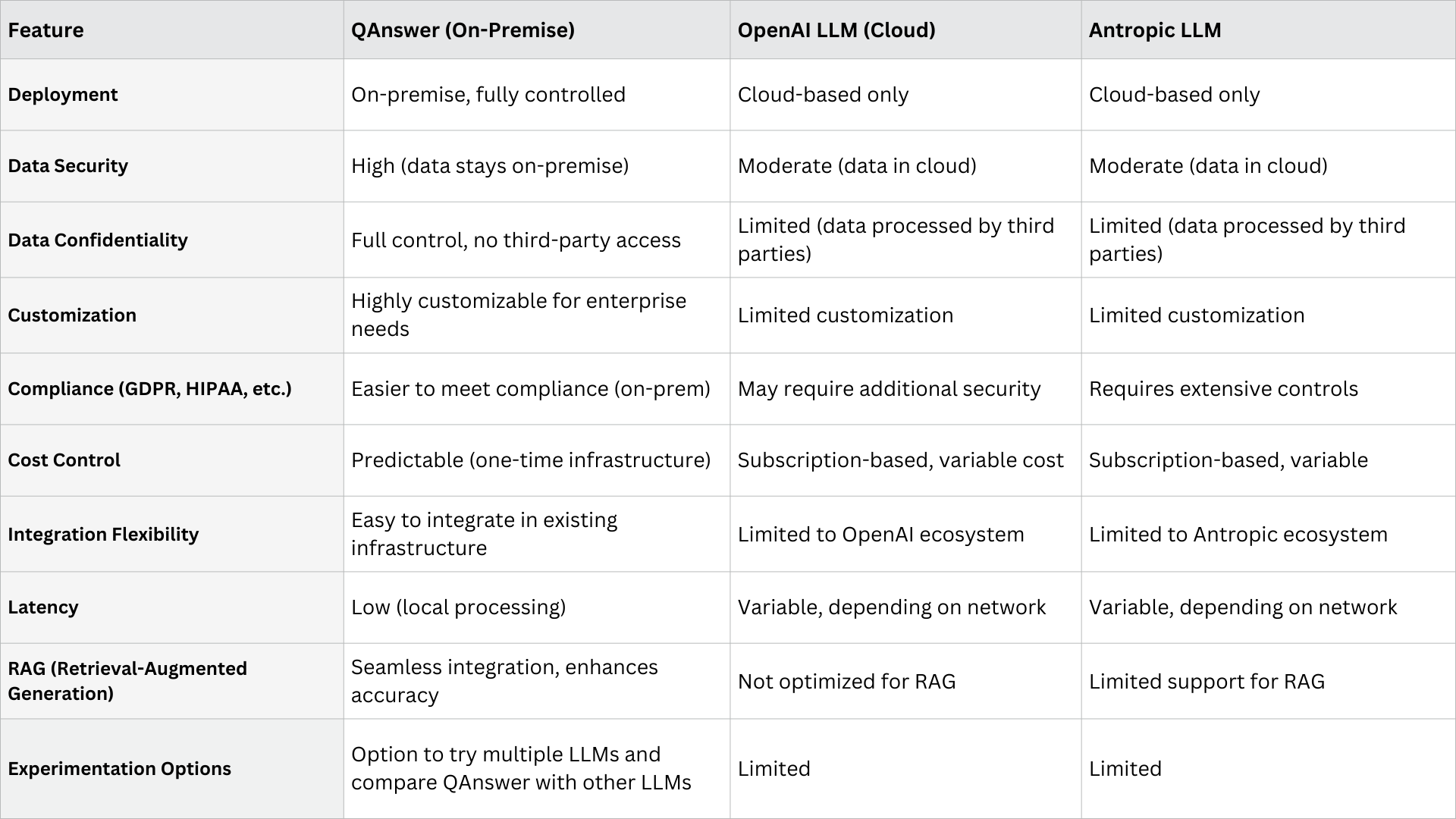

Vergleich von QAnswers on-premise LLM mit anderen cloudbasierten Modellen

Gewinnen Sie tiefere Einblicke durch eine vergleichende Studie der vielversprechendsten und am häufigsten verwendeten Large Language Models (LLMs) von heute.

Kernpunkte - Warum QAnswer?

Die on-premise Lösung von QAnswer bietet Unternehmen ein hohes Maß an Datensicherheit, Vertraulichkeit und Compliance-Kontrolle, das cloudbasierte LLMs oft nicht erreichen können. Mit flexiblen Integrationsoptionen und geringerer Latenz für die lokale Verarbeitung ist QAnswer ideal für Branchen, die Datenschutz und Kostenplanbarkeit priorisieren.

Hier ist eine Übersicht der wichtigsten Vorteile:

- Verbesserte Datensicherheit: Hält alle Dateninteraktionen vollständig innerhalb der Firewall einer Organisation, minimiert den Drittanbieter-Zugriff und schützt sensible Informationen.

- Vollständige Kontrolle und Compliance: Das on-premise Deployment unterstützt strenge Datenschutzstandards und ist damit ideal für regulierte Branchen wie Gesundheitswesen, Finanzen, öffentlicher Sektor und Rechtswesen.

- Kosteneffizienz: Reduziert langfristige Ausgaben durch den Wegfall wiederkehrender Cloud-Abonnementgebühren und ermöglicht Budgetstabilität durch eine einmalige Infrastrukturinvestition.

- Vergleichbare Leistung: Bietet eine Leistung auf Augenhöhe mit Cloud-LLMs, optimiert für die Nutzung bestehender Infrastruktur für schnelle, zuverlässige lokale Verarbeitung.

- Flexibilität mit mehreren LLMs: Unterstützt diverse LLMs (QAnswer LLM, OpenAI LLM, Mistral LLM und mehr) und ermöglicht nahtloses Testen, Experimentieren und Anpassen innerhalb einer einheitlichen Plattform.

- Reduzierte Latenz: Lokale Verarbeitung bietet schnellere Antwortzeiten, die für Echtzeitanwendungen und verbesserte Benutzererfahrungen entscheidend sind.

Fazit

Die Verlagerung hin zu on-premise LLMs stellt eine neue Ära der Unternehmens-KI dar, in der Datenschutz, Kosteneffizienz und Leistung koexistieren. Durch den Einsatz lokaler Sprachmodelle erhalten Unternehmen die vollständige Kontrolle über ihre Daten und minimieren gleichzeitig Risiken durch Dritte. Mit der von QAnswer gebotenen Flexibilität können Organisationen mit verschiedenen Large Language Models experimentieren und die Leistung optimieren, ohne die Vertraulichkeit von Unternehmensdaten zu gefährden.

Beginnen Sie noch heute, die Vorteile von on-premise LLMs zu erkunden, und erschließen Sie neues KI-Potenzial innerhalb Ihrer eigenen Infrastruktur.

Entdecken Sie, wie QAnswer Ihr Unternehmen mit KI stärken kann. Kontaktieren Sie uns unter info@the-qa-company.com

Besuchen Sie unsere Website, um zu erfahren, wie QAnswer die digitale Transformation von Unternehmen mit KI vorantreibt: www.qanswer.ai

Testen Sie QAnswer noch heute und erleben Sie seine Möglichkeiten aus erster Hand: https://app.qanswer.ai/

Vielen Dank! Bis bald mit neuen Updates.

Back to Blog

The AI platform that works.

Try for free today