Published November 21, 2024

Repenser le LLM d'Entreprise : IA Sécurisée et Rentable

9 min read

Samir Yacini

Growth Marketer

Have questions or want a demo?

We're here to help! Click the button below and we'll be in touch.

Get a Demo

AI Summary by QAnswer

Repenser l'IA d'entreprise : un LLM sécurisé et rentable

Alors que l'IA devient centrale pour l'innovation en entreprise, le choix entre les Large Language Models (LLMs) basés sur le cloud et ceux déployés on-premise est plus critique que jamais. Si vous cherchez des moyens d'exploiter les LLMs d'entreprise sans compromettre la sécurité des données ni le contrôle des coûts, vous êtes au bon endroit.

Dans ce guide, je vais vous expliquer comment le déploiement local de LLMs offre des avantages distincts, de la confidentialité accrue des données aux solutions IA économiques. À la fin, vous comprendrez pourquoi de plus en plus d'organisations relocalisent leur IA en interne et comment vous pouvez, vous aussi, rendre votre déploiement de LLM d'entreprise à la fois sécurisé et efficace. C'est parti !

Introduction aux LLMs d'entreprise : tendances et défis

Ces dernières années, les large language models (LLMs) d'entreprise ont gagné en popularité, révolutionnant la façon dont les organisations interagissent avec leurs données et les interprètent. En général, les entreprises s'appuient sur des LLMs basés sur le cloud, qui offrent scalabilité et accessibilité immédiate. Cependant, face à la montée des préoccupations en matière de sécurité des données, de plus en plus d'organisations envisagent des modèles de langage locaux pour garder leurs données à proximité. Ce glissement vers des déploiements LLM on-premise reflète une demande croissante de confidentialité, de contrôle et de conformité, notamment dans les secteurs réglementés tels que la santé, la finance et le droit.

Voyons comment repenser les stratégies de LLM cloud au profit d'un déploiement local pour répondre à ces défis émergents.

Pourquoi les modèles de langage locaux gagnent en popularité

L'attrait des modèles de langage locaux réside dans leur capacité à répondre aux besoins essentiels des entreprises en matière de confidentialité et de contrôle des données. Contrairement aux LLMs hébergés dans le cloud, qui nécessitent l'envoi de données hors site, les modèles on-premise permettent aux organisations d'héberger des solutions IA directement au sein de leur infrastructure. Cette capacité est essentielle pour les secteurs qui traitent des informations sensibles ou propriétaires.

Les déploiements LLM on-premise permettent aux entreprises de respecter des normes réglementaires strictes, car les données sont traitées et stockées sur site, limitant ainsi l'exposition aux réseaux externes. En privilégiant la confidentialité des données d'entreprise, les organisations peuvent bénéficier de l'IA sans compromettre la vie privée.

RAG dans les LLMs d'entreprise : améliorer la précision et l'efficacité

L'un des principaux avantages du déploiement de LLMs on-premise est la possibilité d'intégrer des techniques de Retrieval-Augmented Generation (RAG), qui améliorent la capacité de l'IA à fournir des réponses précises et contextuellement pertinentes. Le RAG combine des modèles de langage avec un système de récupération, permettant aux entreprises d'extraire des données de sources spécifiques et fiables en temps réel. Cette méthode est particulièrement utile dans les secteurs sensibles aux données, où les LLMs peuvent générer des réponses basées sur des informations à jour et sécurisées, stockées localement.

Grâce au RAG, les organisations utilisant les solutions LLM on-premise de QAnswer peuvent améliorer la précision des réponses tout en garantissant que les données restent confidentielles et conformes aux standards internes. Cette fusion de la récupération et de la génération renforce davantage l'attrait des modèles de langage locaux pour les entreprises qui visent à la fois des performances améliorées et une solide protection des données.

L'avantage sécuritaire des LLMs on-premise

L'un des principaux avantages des déploiements LLM on-premise est le niveau de sécurité élevé qu'ils offrent. Les LLMs basés sur le cloud peuvent être vulnérables aux violations de données, car les informations sensibles doivent transiter vers et depuis des serveurs tiers. Avec les LLMs on-premise, les organisations conservent un contrôle exclusif sur leurs données. Cela est particulièrement précieux dans les secteurs où la confidentialité des données et la protection des données d'entreprise ne sont pas négociables.

Chez The QA Company, notre plateforme QAnswer prend en charge des configurations sécurisées qui maintiennent toutes les interactions de données dans le pare-feu de l'organisation, minimisant les risques liés aux accès de tiers et permettant la conformité avec les politiques internes de protection des données.

Performance des LLMs on-premise vs solutions basées sur le cloud

Contrairement à l'idée reçue selon laquelle les modèles cloud seraient intrinsèquement supérieurs, les LLMs on-premise peuvent offrir des niveaux de performance comparables à, voire dépassant, leurs homologues cloud. En exécutant les modèles au sein de leurs propres réseaux, les entreprises peuvent optimiser les performances des modèles de langage locaux selon les spécifications de leur infrastructure.

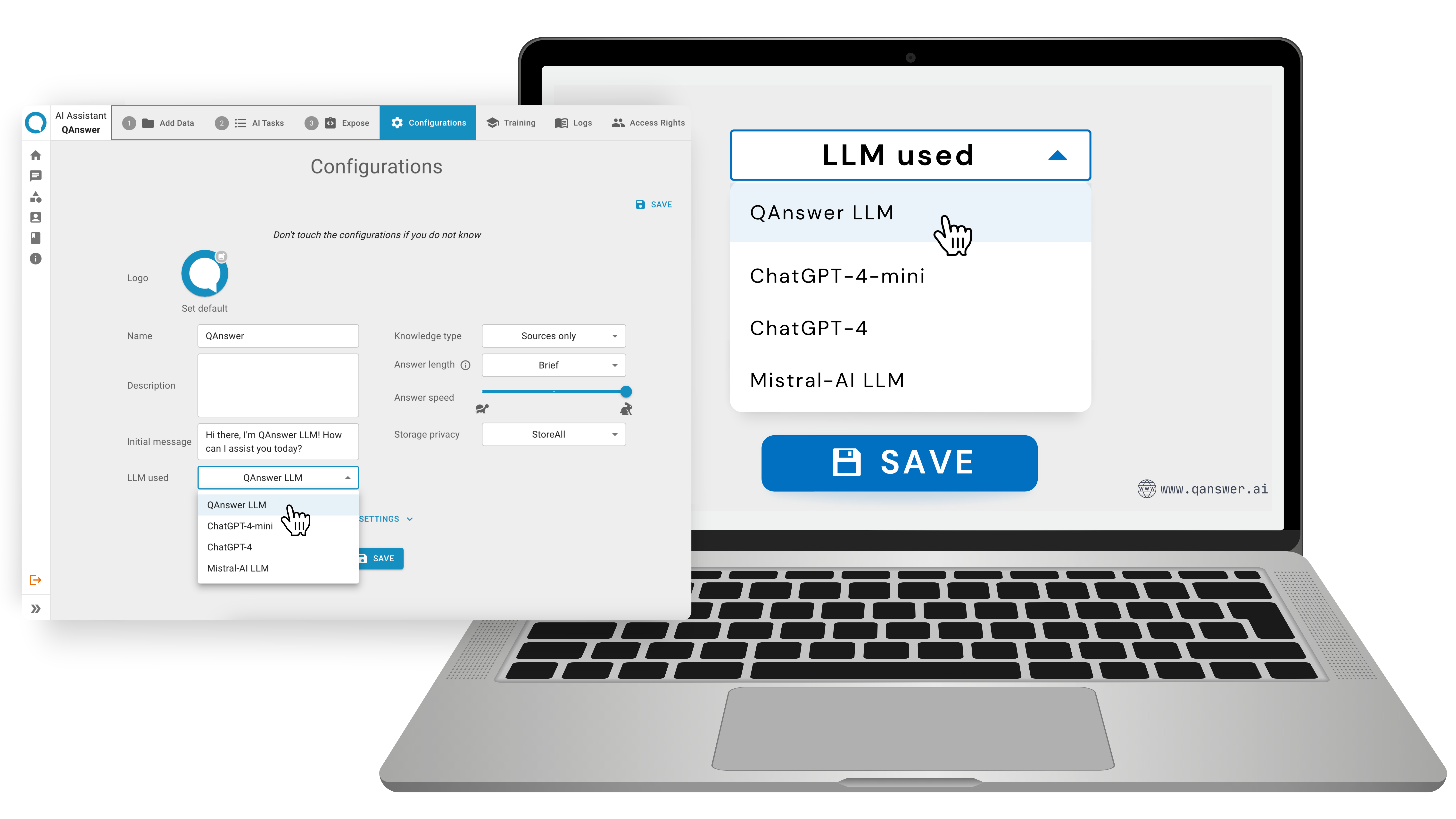

Avec QAnswer, les entreprises ont accès à une gamme de LLMs qu'elles peuvent configurer et tester au sein de la même plateforme. Cette flexibilité facilite la comparaison entre le LLM QAnswer et des LLMs cloud populaires comme OpenAI LLM et Mistral LLM. Ces comparaisons permettent aux entreprises d'adapter les performances à leurs besoins spécifiques.

Avantages de gestion des coûts avec les déploiements LLM locaux

Passer aux déploiements LLM on-premise n'est pas seulement une question de sécurité et de contrôle des données — c'est aussi un choix économique. Les LLMs cloud sont souvent assortis de frais d'abonnement récurrents, qui peuvent s'accumuler considérablement au fil du temps, en particulier pour des besoins en données à grande échelle. Avec des modèles de langage locaux, les entreprises peuvent éviter ces coûts continus. En réalisant un investissement infrastructure unique, les organisations bénéficient d'une prévisibilité budgétaire et d'économies sur le long terme.

Les options LLM on-premise de QAnswer permettent aux entreprises de maintenir une stabilité budgétaire tout en atteignant des performances IA de haute qualité sans frais cloud supplémentaires.

Les options de déploiement LLM polyvalentes de QAnswer

La plateforme QAnswer apporte une flexibilité unique aux déploiements LLM d'entreprise. Elle prend en charge plusieurs LLMs, permettant aux entreprises de passer facilement d'un modèle à l'autre, qu'il s'agisse de modèles open-source ou commerciaux. Par exemple, les entreprises peuvent tester le LLM QAnswer aux côtés de modèles populaires comme OpenAI LLM ou Mistral, sans avoir à quitter la plateforme.

Cette polyvalence permet aux organisations d'expérimenter, d'optimiser et de personnaliser les large language models en fonction de leurs besoins métier spécifiques. En proposant une plateforme unique pour la gestion des LLMs, QAnswer rend l'expérimentation avec les modèles accessible et simple.

Les secteurs bénéficiant des déploiements LLM locaux

Certains secteurs, tels que la santé, la finance, le secteur public et le droit, ont des exigences strictes en matière de sécurité des données et de confidentialité des informations d'entreprise. Ces secteurs ont tout intérêt à adopter des déploiements LLM locaux, où les données sensibles ne quittent jamais l'infrastructure de l'organisation.

Dans le secteur de la santé, par exemple, les données des patients peuvent rester sécurisées au sein de l'établissement tout en bénéficiant de diagnostics et de récupération d'informations assistés par IA. De même, les institutions financières peuvent s'assurer que les données clients restent privées tout en utilisant des LLMs pour l'évaluation des risques ou la détection des fraudes. Les cabinets juridiques peuvent exploiter les LLMs on-premise pour analyser de grands volumes de dossiers juridiques sans compromettre la confidentialité des clients.

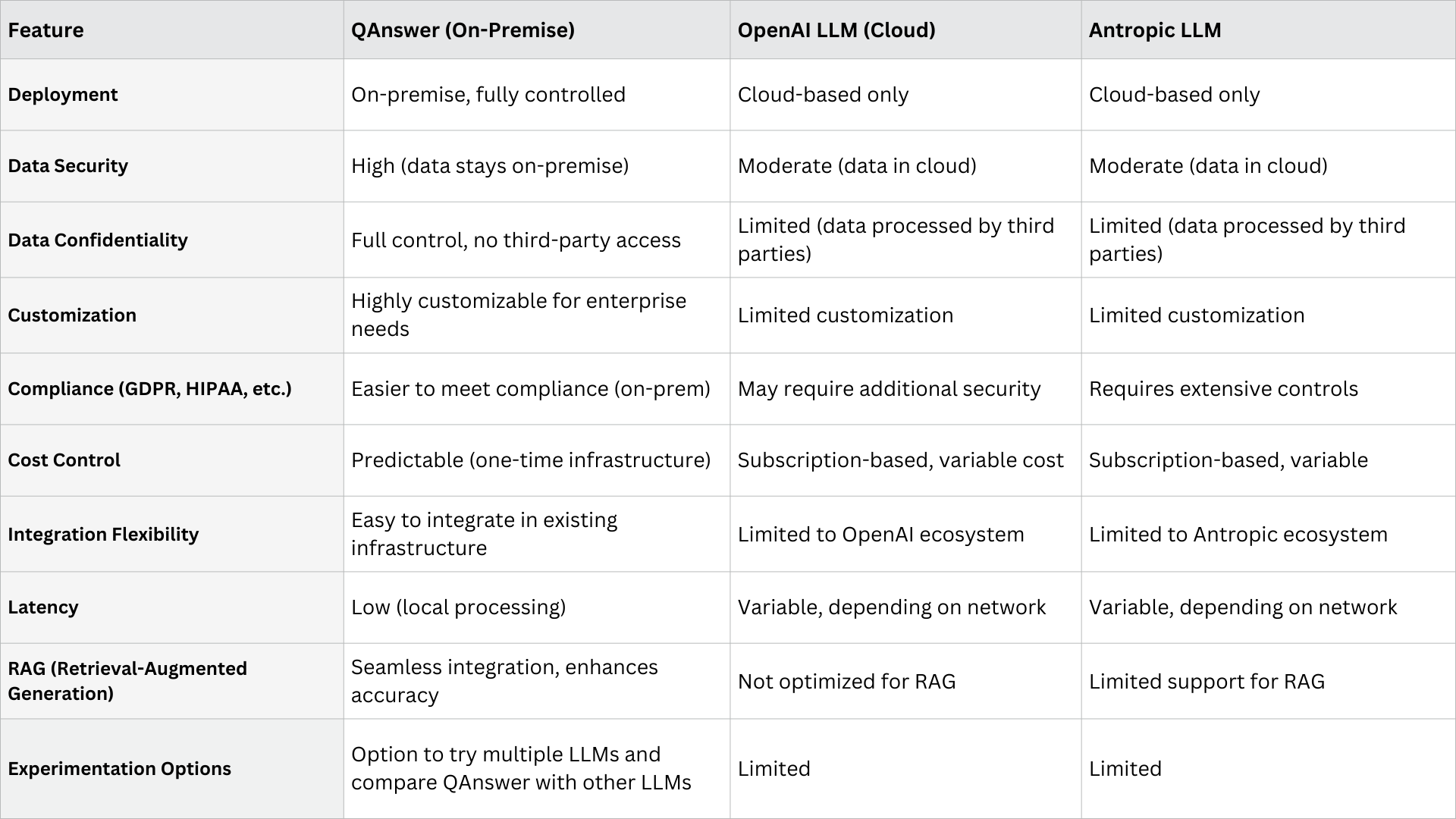

Comparaison du LLM on-premise de QAnswer avec d'autres modèles cloud

Obtenez des insights approfondis grâce à une étude comparative des large language models (LLMs) les plus prometteurs et les plus utilisés aujourd'hui.

Points clés - Pourquoi QAnswer ?

La solution on-premise de QAnswer offre aux entreprises un niveau élevé de sécurité des données, de confidentialité et de contrôle de la conformité que les LLMs basés sur le cloud ne peuvent souvent pas égaler. Avec des options d'intégration flexibles et une latence réduite pour le traitement local, QAnswer est idéal pour les secteurs qui privilégient la confidentialité des données et la prévisibilité des coûts.

Voici un résumé des principaux avantages :

- Sécurité des données renforcée : Maintient toutes les interactions de données au sein du pare-feu de l'organisation, minimisant les accès tiers et protégeant les informations sensibles.

- Contrôle total et conformité : Le déploiement on-premise prend en charge des normes strictes de confidentialité des données, ce qui le rend idéal pour les secteurs réglementés tels que la santé, la finance, le secteur public et le droit.

- Efficacité des coûts : Réduit les dépenses à long terme en éliminant les frais d'abonnement cloud récurrents, permettant une stabilité budgétaire grâce à un investissement infrastructure unique.

- Performance comparable : Offre des performances similaires aux LLMs cloud, optimisées pour exploiter l'infrastructure existante pour un traitement local rapide et fiable.

- Flexibilité avec plusieurs LLMs : Prend en charge divers LLMs (QAnswer LLM, OpenAI LLM, Mistral LLM et d'autres), permettant des tests, des expérimentations et une personnalisation sans friction au sein d'une plateforme unifiée.

- Latence réduite : Le traitement local offre des temps de réponse plus rapides, essentiels pour les applications en temps réel et une meilleure expérience utilisateur.

Conclusion

Le glissement vers les LLMs on-premise représente une nouvelle ère dans l'IA d'entreprise, où la confidentialité des données, la rentabilité et les performances coexistent. En déployant des modèles de langage locaux, les entreprises obtiennent un contrôle total sur leurs données tout en minimisant les risques liés aux tiers. Grâce à la flexibilité offerte par QAnswer, les organisations peuvent expérimenter avec divers large language models, optimisant les performances sans compromettre la confidentialité des données d'entreprise.

Commencez à explorer les avantages des LLMs on-premise dès aujourd'hui et débloquez un nouveau potentiel IA au sein de votre propre infrastructure.

Découvrez comment QAnswer peut renforcer votre entreprise grâce à l'IA. Contactez-nous à info@the-qa-company.com

Visitez notre site web pour découvrir comment QAnswer stimule la transformation des entreprises grâce à l'IA : www.qanswer.ai

Essayez QAnswer dès aujourd'hui et découvrez ses capacités de première main : https://app.qanswer.ai/

Merci ! À très bientôt pour de nouvelles mises à jour.

Back to Blog

The AI platform that works.

Try for free today