Published April 21, 2026

So bauen Sie einen KI-Agenten: Schritt-für-Schritt-Anleitung für 2026

6 min read

Amandine Cami

Commercial Director

Have questions or want a demo?

We're here to help! Click the button below and we'll be in touch.

Get a Demo

AI Summary by QAnswer

Den Aufbau eines KI-Agenten ist eine der wirkungsvollsten Investitionen, die ein Entwicklungs- oder Produktteam im Jahr 2026 tätigen kann. Im Gegensatz zu einfachen Chatbots, die einzelne Fragen beantworten, planen KI-Agenten über mehrere Schritte hinweg, nutzen Werkzeuge, fragen Datenbanken ab und führen Aktionen in externen Systemen durch — alles gesteuert durch natürlichsprachliche Anweisungen. Wenn Sie noch über Ihren Ansatz nachdenken, beginnen Sie mit agentische KI vs. generative KI, um die wesentlichen Unterschiede zu verstehen.

Diese Schritt-für-Schritt-Anleitung führt Sie durch alles, was Sie benötigen, um einen produktionsreifen KI-Agenten zu bauen: von Architekturentscheidungen und Wissensintegration bis hin zu Sicherheitskontrollen und Bereitstellungsstrategien.

Was ist ein KI-Agent?

Ein KI-Agent ist ein Softwaresystem, das ein großes Sprachmodell (LLM) mit einer Reihe von Werkzeugen und einer Planungsschleife kombiniert, die es ihm ermöglicht, Ziele über mehrere Schritte zu verfolgen. Schlüsselkomponenten:

- LLM-Kern — die Schlussfolgerungsmaschine, die Sprache versteht, Schritte plant und Antworten generiert

- Werkzeugregister — APIs, Datenbankverbinder, Websuche, Code-Ausführung, Datei-Lesegeräte

- Gedächtnis — Kurzzeitgedächtnis (Gesprächskontext) und Langzeitgedächtnis (gespeichertes Wissen und Benutzerhistorie)

- Orchestrierungsschleife — die Steuerungslogik, die entscheidet, welches Werkzeug aufgerufen wird, das Ergebnis bewertet und den nächsten Schritt bestimmt

Schritt 1: Umfang und Ziele des Agenten definieren

Der häufigste Fehler in KI-Agenten-Projekten ist die Ausweitung des Umfangs. Bevor Sie eine einzige Zeile Code schreiben, definieren Sie präzise:

- Welches Problem löst der Agent? Seien Sie konkret: „Kundensupport-Fragen zur Abrechnung beantworten" ist besser als „beim Support helfen".

- Welche Aktionen kann er ausführen? Listen Sie jedes Werkzeug auf, auf das er Zugriff haben wird, und jedes System, in das er schreiben kann.

- Was sind die harten Grenzen? Geben Sie an, was der Agent niemals tun sollte — Datensätze löschen, externe E-Mails ohne Genehmigung senden, auf personenbezogene Daten über definierte Felder hinaus zugreifen.

- Wer ist der Benutzer? Interner Mitarbeiter, externer Kunde oder ein anderes KI-System in einer Multi-Agenten-Pipeline?

Schritt 2: Ihr LLM und Ihre Architektur wählen

Das richtige LLM auswählen

Ihre Wahl des LLM beeinflusst Genauigkeit, Kosten, Latenz und — entscheidend für regulierte Organisationen — Datenschutz. Optionen umfassen:

- OpenAI GPT-4o / GPT-4.1 — Starke allgemeine Fähigkeit; Daten werden auf OpenAIs Servern verarbeitet.

- Anthropic Claude 3.7 — Starkes Reasoning und Instruktionsbefolgung; ähnliche Cloud-only-Einschränkung.

- Meta Llama 4 — Open-Weight-Modell, das auf Ihrer eigenen Infrastruktur bereitgestellt werden kann; ausgezeichnet für souveräne Bereitstellungen.

- Mistral — In Europa gehostete Option mit DSGVO-freundlicher Bereitstellung und starker mehrsprachiger Leistung.

Einzelagenten- vs. Multi-Agenten-Architektur

Für die meisten Erstbereitstellungen ist ein einzelner Agent mit einem klar definierten Werkzeugset einfacher zu bauen, zu debuggen und zu steuern. Multi-Agenten-Architekturen (bei denen spezialisierte Agenten bei komplexen Aufgaben zusammenarbeiten) bieten mehr Leistung, erfordern aber sorgfältige Orchestrierung und Konfliktlösungslogik.

Schritt 3: Die Wissensbasis aufbauen und verbinden

Ein KI-Agent ist nur so gut wie das Wissen, auf das er Zugriff hat. Eine verankerte Wissensbasis verhindert Halluzinationen und stellt sicher, dass Antworten auf verifizierten, aktuellen internen Inhalten basieren.

- Prüfen Sie Ihre Wissensquellen — identifizieren Sie, wo Ihre wichtigsten Inhalte liegen: SharePoint, Confluence, PDFs, SQL-Datenbanken, REST-APIs.

- Richten Sie eine Abrufpipeline (RAG) ein — indizieren Sie Ihre Inhalte in einer Vektordatenbank, damit der Agent zur Abfragezeit relevante Passagen abruft.

- Konfigurieren Sie Chunking und Metadaten — teilen Sie Dokumente in semantisch kohärente Einheiten auf und fügen Sie Metadaten (Quelle, Datum, Abteilung) hinzu, um präzises Filtern zu ermöglichen.

- Legen Sie einen Neuindizierungsplan fest — Wissensbasen verfallen. Richten Sie automatische Neuindizierung ein, wenn Quelldokumente aktualisiert werden.

Schritt 4: Das Werkzeugregister implementieren

Werkzeuge sind die Art und Weise, wie ein Agent mit der Welt interagiert. Jedes Werkzeug ist eine Funktion, die das LLM aufrufen kann, wenn es Informationen benötigt oder eine Aktion durchführen muss. Gängige Werkzeugkategorien:

- Wissensabruf — die Vektordatenbank durchsuchen, eine SQL-Tabelle abfragen, ein Dokument aus SharePoint abrufen

- Externe API-Aufrufe — Bestellstatus in einem ERP prüfen, einen Kundendatensatz in einem CRM nachschlagen

- Code-Ausführung — Berechnungen durchführen, Dateien verarbeiten, Diagramme generieren

- Kommunikation — ein Ticket erstellen, in Slack posten (mit geeigneten Genehmigungsstufen)

Definieren Sie jedes Werkzeug mit einem klaren Namen, einer Beschreibung und einem Parameterschema. Das LLM verwendet diese Beschreibungen, um zu entscheiden, welches Werkzeug wann aufgerufen werden soll.

Schritt 5: Sicherheits- und Governance-Kontrollen implementieren

KI-Agenten, die Aktionen ausführen, erfordern sorgfältiges Sicherheitsdesign. Implementieren Sie diese Kontrollen vor der Bereitstellung in der Produktion:

- Mensch-in-der-Schleife-Kontrollpunkte für irreversible Aktionen (E-Mails senden, Datensätze löschen, Finanztransaktionen)

- Minimale Berechtigungen — jedes Werkzeug sollte nur den Zugriff haben, den es für seinen definierten Zweck benötigt

- Ratenbegrenzung — verhindern Sie unkontrollierte Schleifen durch Begrenzung der Werkzeugaufrufe pro Sitzung

- Halluzinationserkennung — verwenden Sie RAG-verankerte Antworten und verlangen Sie, dass der Agent Quellen für sachliche Behauptungen zitiert. Das Verstehen von LLM-Nicht-Determinismus hilft Ihnen, für konsistentere Ausgaben zu optimieren.

- Vollständige Audit-Protokollierung — zeichnen Sie jeden Werkzeugaufruf, seine Eingaben und seine Ausgaben auf

Schritt 6: Testen, Evaluieren und Iterieren

Das Testen von KI-Agenten erfordert mehr als Unit-Tests. Bewerten Sie das Agentenverhalten in verschiedenen realistischen Szenarien:

- Golden-Set-Evaluierung — ein kuratierter Satz von Testabfragen mit bekannten richtigen Antworten; messen Sie Genauigkeit, Vollständigkeit und Zitierqualität

- Adversariales Testen — versuchen Sie, den Agenten mit mehrdeutigen, widersprüchlichen oder themenfremden Eingaben zu verwirren

- Abdeckung von Grenzfällen — testen Sie, was passiert, wenn ein Werkzeug einen Fehler zurückgibt oder die Wissensbasis keine relevanten Inhalte hat

- Lasttests — validieren Sie, dass Latenz und Genauigkeit unter gleichzeitiger Nutzung auf Produktionsniveau standhalten

Schritt 7: Bereitstellen und Überwachen

Die Bereitstellung ist nicht die Ziellinie — es ist der Beginn des Verbesserungszyklus. In der Produktion:

- Überwachen Sie Gesprächsprotokolle auf unbeantwortete oder schlecht beantwortete Fragen

- Verfolgen Sie die Eskalationsrate und die Erstlösungsrate

- Überprüfen Sie Werkzeugaufrufmuster auf unerwartetes Verhalten

- Sammeln Sie Benutzerfeedback und verwenden Sie es, um die Wissensbasis und Systemaufforderungen zu verfeinern

Wie QAnswer die KI-Agenten-Entwicklung beschleunigt

Den Aufbau eines produktionsreifen KI-Agenten von Grund auf erfordert monatelangen Ingenieuraufwand über RAG-Infrastruktur, Tool-Integration, Sicherheitskontrollen und Überwachung. QAnswer stellt diese Infrastruktur als Plattform bereit, sodass sich Ihr Team auf die Agentenlogik und den Geschäftswert konzentriert — nicht auf die Grundlagenarbeit. Wenn Sie externe Partner evaluieren, lesen Sie unseren Leitfaden zur Auswahl eines KI-Agenten-Entwicklungsunternehmens.

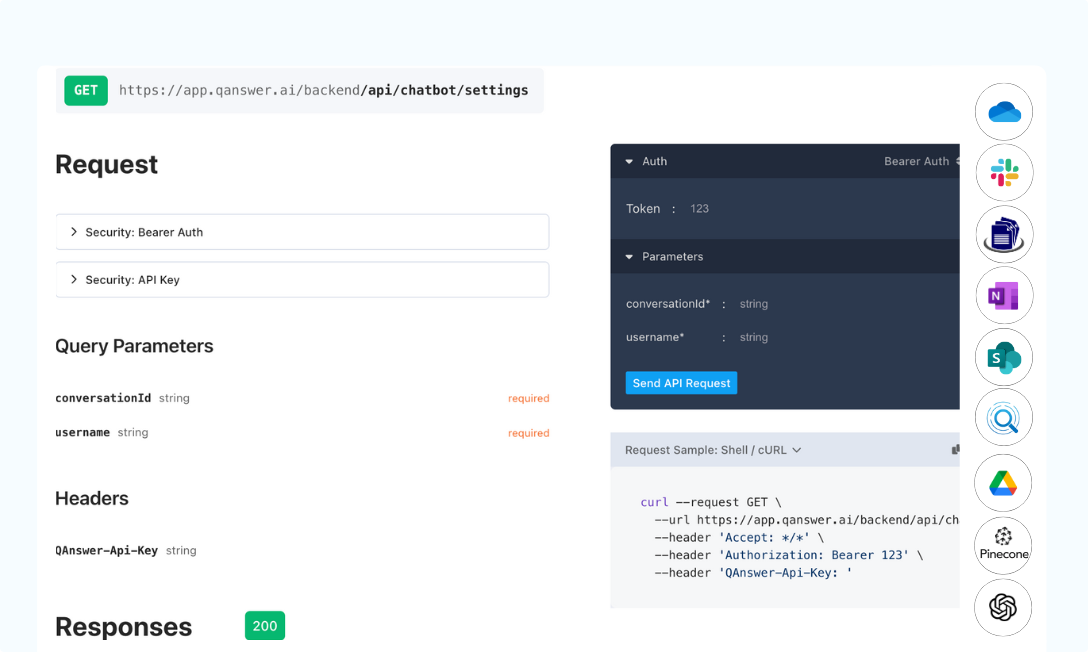

- Vorgefertigte RAG-Pipeline — Dokumentenaufnahme, Vektorindizierung und Abruf sofort einsatzbereit. Verbinden Sie eine Datenquelle und Ihr Agent verfügt innerhalb von Minuten über verankertes Wissen.

- Über 100 Datenquellen-Konnektoren — SharePoint, Confluence, Google Drive, SQL, REST-APIs, Notion und mehr — mit automatischer Neuindizierung bei Inhaltsänderungen.

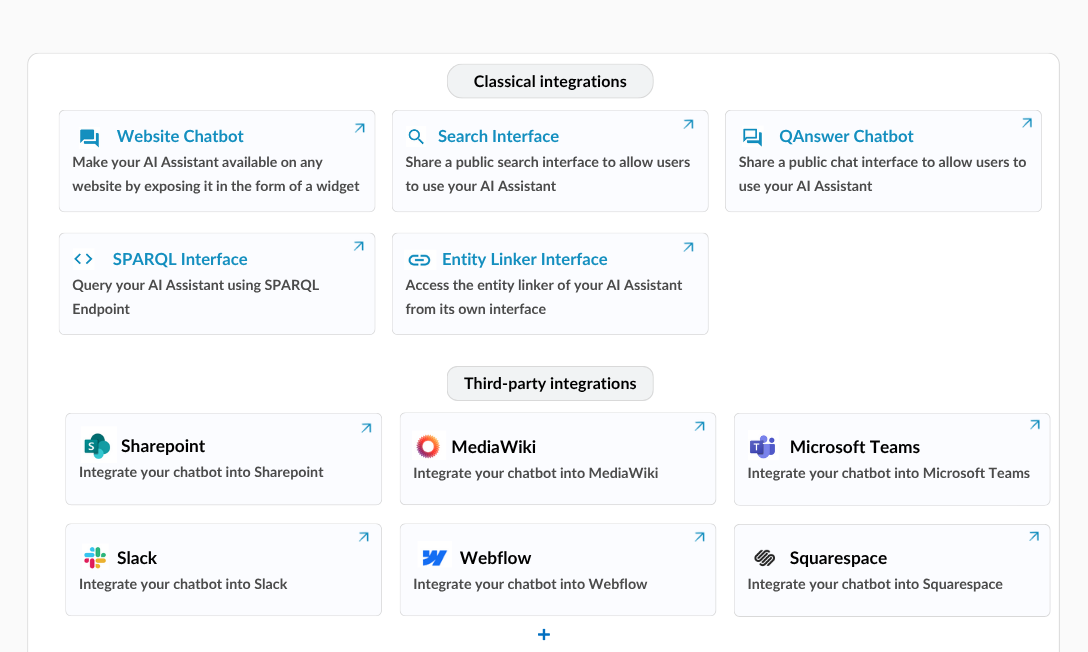

- Multi-Channel-Bereitstellung — Stellen Sie denselben Agenten auf Ihrer Website, in Microsoft Teams, Slack, WhatsApp oder über REST-API bereit, ohne die Konfiguration zu duplizieren.

- Souveräne Infrastruktur — vollständige On-Premise- und Private-Cloud-Bereitstellung. ISO 27001 zertifiziert. Ihre Daten bleiben in Ihrer Umgebung.

- Eingebaute Überwachung und Protokolle — Gesprächsanalysen, Verfolgung unbeantworteter Fragen und Feedback-Sammlung ab dem ersten Tag inklusive.

Fazit

Den Aufbau eines KI-Agenten, der echten Geschäftswert liefert, erfordert sorgfältige Architektur, robuste Wissensintegration und rigorose Sicherheitskontrollen. Die Organisationen, die dies im Jahr 2026 richtig machen, werden mit einem bedeutenden und kumulativen Vorteil gegenüber denjenigen operieren, die es nicht tun.

Bereit, Ihren ersten produktionsreifen KI-Agenten zu bauen? Sprechen Sie mit dem QAnswer-Team — und sehen Sie, wie schnell Sie von der Datenquelle zum bereitgestellten Agenten gelangen können.

Back to Blog

The AI platform that works.

Try for free today